你当前正在访问 Microsoft Azure Global Edition 技术文档网站。 如果需要访问由世纪互联运营的 Microsoft Azure 中国技术文档网站,请访问 https://docs.azure.cn。

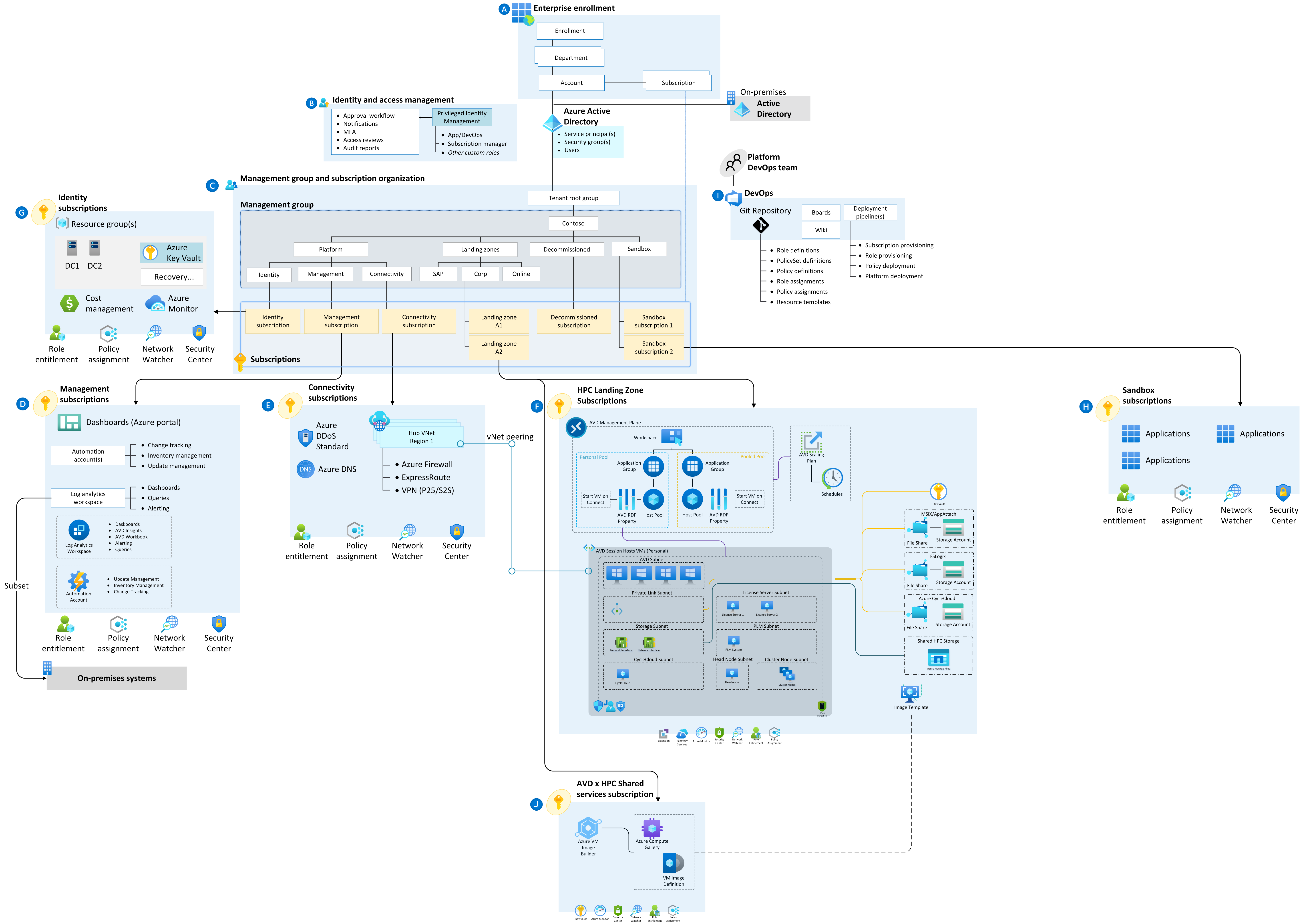

高性能计算(HPC)登陆区域加速器可自动部署环境。 此环境提供了一个基本框架,可以自定义该框架,以便为 Azure 中完整的 HPC 群集解决方案创建端到端部署机制。 加速器是一系列开源脚本和模板,可用于准备企业级登陆区域。 它可以提供特定的体系结构方法和遵循云采用框架的体系结构和最佳做法的参考实现。

客户采用各种方式采用 HPC 以满足其业务需求,你可以调整 HPC 登陆区域加速器,以生成适合 你的 方式的体系结构。 使用加速器有助于使组织走上可持续规模的道路。

实现企业级着陆区

HPC 登陆区域加速器假设你从已成功实现的企业规模登陆区域开始。 有关此先决条件的详细信息,请参阅以下文章:

HPC 登陆区域加速器提供的内容

HPC 登陆区域加速器的登陆区域策略为你的项目提供以下资产:

- 有助于评估关键决策的设计准则

- 登陆区域体系结构

- 包含以下内容的实现:

- 可部署参考,能够为你的 HPC 部署创建环境

- Microsoft批准的 HPC 参考实现,用于测试已部署的环境

能源、制造和金融设计指南

除组织不同外,登陆区域的体系结构因业务部门而异。 本部分列出了为创建登陆区域提供指南的文章:

为 AI 工作负载选择 HPC 计算的设计准则

为 AI 工作负荷选择正确的 GPU 优化计算 SKU 对于优化性能和控制成本非常重要。 Microsoft提供了许多不同的 SKU,这些 SKU 针对受益于更多 GPU 电源的工作负载进行了优化。 为 AI 工作负载选择合适的 SKU 时,有几个注意事项。 较小的工作负载可能仅利用像 NDv6 这样更强大的 SKU 的 CPU、GPU 和带宽的一小部分。 对于较小的作业,你可能希望考虑其他计算 SKU,例如 NCv4 和 NDv4。 为 AI 工作负载选择正确的 GPU 优化计算 SKU 时,请考虑以下因素:

- 检查点。 考虑运行机器学习模型时检查点间隔等因素。 这可能会影响训练阶段的 GPU 性能。 在存储效率与保持 GPU 操作流畅之间取得平衡。 监视 GPU 使用情况。

- 推理。 推断要求与训练要求不同,CPU 负载可能更高,可能会使 CPU 性能达到最大。 选择计算 SKU 时,请考虑模型的推理要求。 监视 CPU 使用情况。

- 训练。 考虑训练期间模型的要求,监视 CPU 和 GPU 使用情况。

- 作业调整大小。 在考虑 AI 工作负载的计算资源 SKU 时,请考虑作业的大小。 较小的作业(如大约 OPT 1.3B 的作业)可能无法利用更大的 SKU 大小,并且可能会根据作业的阶段(推理、训练)使 CPU 和 GPU 电源处于空闲状态。

- 带宽。 如果没有使用,更大的、较低的延迟带宽可能是一种费用。 对于需要额外带宽的最大模型,请考虑 InfiniBand。

查看 Azure 的 GPU 优化虚拟机大小。

示例:能源的概念参考体系结构

以下概念参考体系结构是一个演示 能源 环境设计领域和最佳做法的示例。

示例:财务概念参考体系结构

以下概念参考体系结构是一个演示 财务 环境设计领域和最佳做法的示例。

示例:用于制造的概念参考体系结构

以下概念参考体系结构是一个演示 制造 环境设计领域和最佳做法的示例。

获取 HPC 登陆区域加速器

若要部署 HPC 登陆区域加速器,请使用 Azure 市场或 Azure CLI。

若要通过 Azure 市场进行部署,请参阅 使用 Azure 市场部署适用于 Slurm 的 Azure CycleCloud 工作区。

若要通过 CLI 进行部署,请参阅 使用 CLI 部署用于 Slurm 环境的 Azure CycleCloud 工作区。

若要了解有关此加速器解决方案的详细信息,请参阅 适用于 Slurm 的 Azure CycleCloud 工作区。

后续步骤

有关 HPC 登陆区域加速器体系结构的注意事项和建议,请查看 Azure 标识和访问管理中 HPC 登陆区域加速器的关键设计区域。